Googlebot 是什么

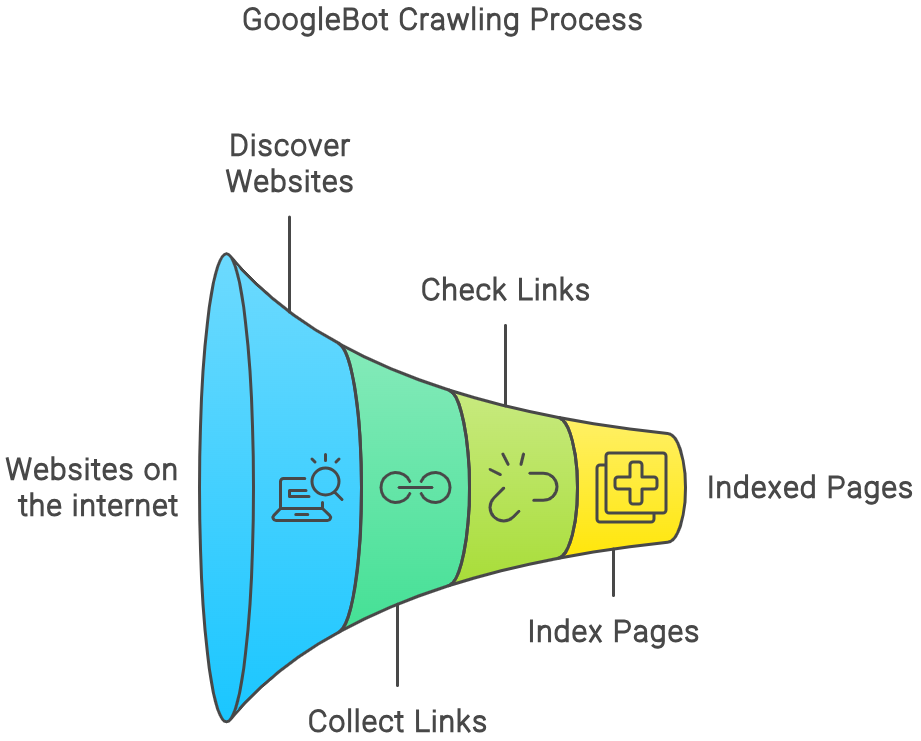

Googlebot 是 Google 的网页抓取程序(爬虫),负责在互联网上发现页面、抓取内容,并将其送入索引管道,最终呈现在搜索结果中。网络空间极其庞大,Googlebot 对任何站点可分配的抓取预算(Crawl Budget)有限,因此优化抓取效率是技术 SEO 的基本功。

Gary Illyes 在 Google 搜索中心播客中曾明确指出:Googlebot 不会直接 follow 链接,而是先将链接收集到 URL 队列数据库中,再按优先级逐个调度抓取。这与传统意义上的 "顺着链接爬" 有本质区别。

为什么要关注抓取效率?抓取速率直接影响 Google 发现、索引和排名你内容的速度。如果 Googlebot 在低价值页面上浪费了大量预算,新发布的重要内容可能迟迟无法被索引。关于抓取预算的深入分析,可以参考爬虫预算与日志分析。

Googlebot 类型与 User-Agent

Googlebot 并非单一爬虫,而是一组不同用途的抓取程序:

| 爬虫名称 | User-Agent 标识 | 用途 | 是否执行 JS |

|---|---|---|---|

| Googlebot(桌面) | Googlebot/2.1; compatible | 主索引抓取 | 是(WRS,基于 Chromium) |

| Googlebot(移动) | Googlebot Mobile | Mobile-First Indexing 主力 | 是 |

| Googlebot-Image | Googlebot-Image/1.0 | 图片索引 | 否 |

| Googlebot-Video | Googlebot-Video/1.0 | 视频索引 | 否 |

| Googlebot-News | Googlebot-News | Google News 抓取 | 否 |

| Google-Extended | Google-Extended | Gemini / AI 训练数据采集 | 否 |

其中 Google-Extended 是 2023 年新增的 User-Agent,用于控制是否允许 Google 将你的内容用于 Gemini 等 AI 模型训练。在 robots.txt 中可以单独对其设置 Disallow,而不影响正常搜索索引。

怎么查看抓取数据

- 在左侧导航菜单中,点击 "设置"(Settings)。

- 在设置页面中,找到 "抓取统计信息"(Crawl Stats) 并点击进入。

抓取统计信息页面会展示过去 90 天内的抓取请求总数、平均响应时间、下载大小等关键指标。重点关注:

- 抓取请求趋势:是否有异常波动(骤升可能是蜘蛛陷阱或被入侵,骤降可能是服务器或 robots.txt 配置问题)

- 响应代码分布:200、301、404、500 的占比,大量 4xx/5xx 表明存在需要修复的技术问题

- 文件类型分布:HTML 应占主体,如果 JS/CSS/ 图片占比过高,说明资源抓取效率不佳

抓取效率优化清单

1. Robots.txt 精细化管控

通过 robots.txt 可以阻止 Googlebot 抓取低价值路径(如后台管理页、搜索结果页、筛选参数页),将抓取预算集中在核心内容上。需要注意的是,robots.txt 的 Disallow 指令是 "建议" 而非强制,Googlebot 在大多数情况下会遵守,但不保证 100% 生效。

2. Sitemap 策略

站点地图帮助 Googlebot 理解站点结构和页面优先级。关键原则:

- 只收录可索引的 200 状态页面,移除重定向、noindex 和已删除的 URL

- 合理使用

<priority>和<lastmod>,让 Googlebot 优先抓取高价值或近期更新的页面 - 大型站点可按内容类型拆分为多个子 sitemap(产品、文章、分类页等)

3. URL 参数管理

URL 参数(如 ?category=shoes&color=red)如果没有正确处理,会导致 Googlebot 反复抓取本质相同的页面,严重浪费抓取预算。对策:

- 为参数页设置 canonical 标签指向规范 URL

- 在 robots.txt 中 Disallow 不必要的参数路径

- 对于电商网站的筛选 / 排序参数,优先使用 JavaScript 前端处理而非生成新 URL

4. 避免蜘蛛陷阱

无限滚动分页、日历生成页面、Session ID URL 等都可能制造蜘蛛陷阱(Spider Trap),让 Googlebot 陷入无限循环。参照 Google 的分页加载规范,确保分页有明确的终止点。

5. 服务器性能与响应

- DNS 解析延迟、服务器超时、频繁 5xx 错误都会导致 Googlebot 降低抓取频率

- 利用

If-Modified-Since请求头,让服务器在页面未更新时返回 304 Not Modified,节省双方带宽 - 保持页面响应时间在 200ms 以内,避免因慢响应拖累抓取效率

6. JavaScript 渲染与抓取

Googlebot 使用基于 Chromium 的 Web Rendering Service(WRS)来执行 JavaScript,但渲染需要额外的调度队列和计算资源,等待时间从几秒到几天不等。对于 SEO 关键页面,建议采用 SSR(服务端渲染)或 SSG(静态生成),确保 Googlebot 首次抓取 HTML 时就能获取完整内容。关于 JS 渲染对 SEO 的影响,参见 JS 渲染与 SEO 的详细分析。

AI 爬虫与 Googlebot 对比

2023 年以来,除了传统搜索爬虫,大量 AI 爬虫涌入互联网。它们的目标不是建立搜索索引,而是为大语言模型采集训练数据,或为 AI 搜索产品实时检索内容。以下是主流 AI 爬虫与 Googlebot 的行为对比:

| 特征 | Googlebot | GPTBot (OpenAI) | ClaudeBot (Anthropic) | PerplexityBot |

|---|---|---|---|---|

| 目的 | 搜索索引 | 模型训练 + ChatGPT 搜索 | 模型训练 | 实时检索回答 |

| 执行 JavaScript | 是(完整 Chromium WRS) | 否 | 否 | 否 |

| 遵守 robots.txt | 是 | 是 | 是 | 部分遵守(曾有争议) |

| 抓取频率 | 持续、按算法调度 | 高频批量抓取 | 中频批量抓取 | 用户查询触发,实时抓取 |

| Crawl-delay 支持 | 不支持(自行调节) | 不支持 | 不支持 | 不支持 |

| 对服务器的压力 | 自适应限速 | 可能造成峰值压力 | 相对温和 | 分散但持续 |

| 内容用途 | 索引 + 排名 | 训练数据 + 实时检索 | 训练数据 | 实时摘要引用 |

AI 爬虫的关键差异

不执行 JavaScript 是最大的区别。GPTBot、ClaudeBot、PerplexityBot 均以纯 HTTP 请求方式抓取页面,不运行任何客户端 JavaScript。这意味着依赖 CSR(客户端渲染)的页面,其动态加载的内容对 AI 爬虫完全不可见。如果你希望内容被 AI 引擎引用,SSR 或 SSG 不再是可选项,而是必要条件。

抓取行为缺乏透明度。Googlebot 通过 GSC 提供完整的抓取统计、抓取错误报告和 URL 检查工具。AI 爬虫没有任何等价的反馈机制——你无法知道 GPTBot 抓了哪些页面、抓取是否成功、内容被用于了什么目的。

robots.txt 是目前唯一的管控手段。你可以在 robots.txt 中分别对 GPTBot、ClaudeBot、PerplexityBot 设置规则。如果你想允许 AI 搜索引用但拒绝训练,目前只有 Google 的 Google-Extended 提供了这种粒度区分。此外,llms.txt 作为一种新兴协议,正在尝试为 AI 爬虫提供更结构化的内容导览,值得关注。

2025-2026 年 Googlebot 行为变化

抓取频率整体下降

多个大型站点在 2025 年下半年观察到 Googlebot 抓取频率同比下降 20-40%。这并非偶然——Google 在效率层面持续优化,减少对低变化频率页面的重复抓取,将资源集中在新内容发现和高价值页面的刷新上。这一演进的技术基础是 2009 年推出的 Caffeine 索引架构——它让 Google 从定期全量重建索引转变为持续增量更新,为后来的实时索引和更智能的抓取调度奠定了基础。Gary Illyes 在 2025 年 PubCon 上确认:"我们抓取的页面数量在减少,但索引覆盖率在提高。"

Google-Extended 与 AI 训练分离

2024 年底,Google 进一步明确了 Google-Extended 的语义:屏蔽 Google-Extended 只会阻止 Gemini 训练用途,不影响 AI Overviews 对你内容的引用。这对站长意味着一个重要选择——你可以拒绝成为训练语料,但仍然保持在 Google AI 搜索结果中的可见性。

WRS 升级与渲染能力提升

Google 的 Web Rendering Service 在 2025 年保持了与 Chrome 稳定版同步更新的节奏。截至 2026 年初,WRS 运行的 Chromium 版本已支持所有主流 Web API。这意味着 Googlebot 的 JS 渲染能力基本等同于真实浏览器——但渲染仍然需要额外的调度时间,SSR 优先的建议没有改变。

HTTP/2 抓取的全面铺开

Google 在 2024 年开始逐步将 Googlebot 的抓取协议从 HTTP/1.1 迁移到 HTTP/2,到 2025 年底已覆盖大部分站点。HTTP/2 的多路复用特性让 Googlebot 可以在单个连接上并行请求多个资源,减少了 TCP 连接开销,对大型站点的抓取效率有明显提升。

抓取配额与 AI Overviews 的关联

一个值得注意的趋势是:被 AI Overviews 频繁引用的页面,其 Googlebot 抓取频率也相应提升。这暗示 Google 可能在为 AI 搜索功能建立了单独的抓取优先级队列——被 AI 引用的内容需要更高的新鲜度保障。

5 个常见误区

误区 1:网站越大,Googlebot 抓取越多

Googlebot 的抓取基于算法调度和页面价值判断,优先抓取高质量、更新频繁的页面。大站点如果存在大量低质量或重复页面,反而会拉低整体抓取效率。

误区 2:抓取越多 = 网站权重越高

高频抓取不等于高质量信号。以下情况都可能导致抓取量异常升高:

- 被入侵:Googlebot 会因发现大量新 URL(挂马页面、注入页面)而增加抓取

- 蜘蛛陷阱:参数爆炸或无限分页导致 URL 数量膨胀

- 重复内容:缺少 canonical 导致同一内容被多个 URL 反复抓取

反过来,一个高质量但更新频率低的站点,抓取量较少是完全正常的。

误区 3:Googlebot 只抓取文本

Googlebot 有专门的图片爬虫(Googlebot-Image)和视频爬虫(Googlebot-Video),并且主爬虫通过 WRS 可以执行 JavaScript、渲染完整页面。但这不意味着可以随意使用客户端渲染——JavaScript 渲染的调度延迟和资源消耗仍然是实际约束。

误区 4:发布新内容就会自动提高抓取频率

新内容会吸引 Googlebot 重新评估抓取计划,但最终的抓取频率还受站点整体质量、历史抓取表现、服务器响应速度等综合因素影响。如果内容质量不佳(如纯 AI 生成、无原创见解),Google 可能反而降低对站点的抓取投入。

误区 5:可以强制 Googlebot 更频繁抓取

Googlebot 的抓取频率由算法决定,人为干预通常无效甚至适得其反。通过 GSC 的 URL 检查工具手动提交请求索引只是加入队列,不保证立即执行。另一个常见的错误认知是 "降低抓取频率可以提高排名"——新内容无法被及时索引是严重的 SEO 问题。

常见问题

-

要禁止 Googlebot 抓取特定页面?使用 robots.txt 设置 Disallow 规则。需要注意 robots.txt 阻止的是抓取而非索引——如果页面已经有外链指向,Google 仍可能将其收录在索引中(只是没有内容摘要)。

-

不希望某些页面出现在搜索结果中?使用

noindex元标签或 HTTP 头,并在 GSC 删除页面功能中提交临时删除请求。 -

需要完全阻止所有访问?使用密码保护或服务器端访问控制。但从 SEO 角度,避免使用基于地区的 IP 屏蔽——Googlebot 主要从美国 IP 段发起抓取,地区封锁可能误伤搜索爬虫。

-

爬虫抓取压力过大?Google 会自行调节抓取速度。如果服务器确实扛不住,返回

429 Too Many Requests或503 Service Unavailable状态码,Googlebot 会自动降速。极端情况下可提交过度抓取报告。 -

Googlebot 会测量页面性能分数吗?不会。Core Web Vitals 数据来源于 Chrome 真实用户体验报告(CrUX),而非 Googlebot 抓取。LCP、INP 和 CLS 这些指标是通过浏览器的实际访问行为采集的。

-

如何管理 AI 爬虫的访问?在 robots.txt 中为每个 AI 爬虫(GPTBot、ClaudeBot、PerplexityBot、Google-Extended 等)单独设置规则。如果希望为 AI 爬虫提供结构化的内容导览,可以了解 llms.txt 协议。更多关于爬虫分类和管理策略,参见好坏 BOT 区分指南。

.png)